|

Nouvelle série, n°7

2nd semestre 2021 |

|

||

|

RECHERCHES |

||||

|

TÉLÉCHARGER LA SECTION |

SOMMAIRE |

TÉLÉCHARGER CET ARTICLE |

||

Médias et sphères de justice : réduire la prédominance des plateformes internet de recommandation

Rémy Demichelis, Université Paris Nanterre

Résumé

Les réglementations et les initiatives des plateformes pour s’attaquer aux problèmes des propos illicites en ligne, de la désinformation et de la captation de la valeur journalistique se mettent en place de façon très segmentée. Ce texte suggère d’améliorer la situation sur ces trois enjeux en même temps en autorisant les entités de presse à brancher leurs propres algorithmes de recommandation de contenus sur les plateformes internet qui ont fait de la hiérarchisation de l'information leur fonds de commerce. Il s’agit du moins de réduire la tyrannie de ces dernières sur la sphère de la presse. L'analyse reprend celle du philosophe américain Michael Walzer qui définit la tyrannie comme une situation où les biens propres à une sphère deviennent nécessaires pour acquérir les biens d'une autre sphère. Une société juste étant constituée d’une pluralité de sphères qui doivent posséder chacune leur autonomie. L’apport théorique du présent article est toutefois de souligner qu'il faut une perméabilité encadrée entre ces sphères si nous ne voulons pas laisser prédominer une seule d'entre elles.

Abstract

Regulations and platform initiatives to address the problems of illegal online speech, misinformation, and the capture of journalistic value are being implemented in a very segmented way. This paper suggests a common solution to these three issues by authorizing press entities to connect their own content recommendation algorithms to the internet platforms that have made information prioritization their business. More modestly, the goal is to at least lower the tyranny of the big tech companies toward the sphere of the press. The analysis follows that of American philosopher Michael Walzer who defines tyranny as a situation when one sphere’s goods become mandatory to get another sphere’s goods. A situation of justice being when society’s spheres keep their autonomy. The theoretical contribution of this paper is to underline however that a regulated permeability between spheres is necessary if we do not want to let one of them become tyrannical.

DOI: 10.31188/CaJsm.2(7).2021.R067

L

es plateformes internet de recommandation telles que les réseaux sociaux, les moteurs de recherche ou les agrégateurs ont pris une place prédominante dans le récit de l’actualité. Même si certaines sont parfois dénommées « médias sociaux », elles sont pourtant loin de se réclamer de la presse et entretiennent cette différenciation. Elles se défendent ainsi d’accaparer une fonction similaire.

Néanmoins, la hiérarchisation de l’information grand public, une tâche historiquement reconnue comme un travail journalistique, est en partie délaissée aux grands acteurs du numérique et à leurs propres formules informatiques malgré un marché oligopolistique. Sont concernés des outils tels que Google News, Apple News, Twitter ou Facebook.

Ils définissent ainsi l’espace public dans des proportions démesurées : que ce soit en temps passé sur leur support par les internautes ou bien au travers de l’acquisition de visiteurs sur les sites d’information. Pour les réseaux sociaux, les individus disposant d’une connexion internet y passent en moyenne 2 heures et 25 minutes1 par jour (Kemp, 2021, p. 21). Ce genre de plateforme représente entre 15 % et 20 % du trafic sur le site des Échos, mais peut concerner 50 % pour des sites destinés aux jeunes adultes comme Les Échos Start2. Pour le New York Times ou Le Monde, les réseaux sociaux représentent environ 7 % à 8 % (SimilarWeb, 2021a, 2021b) de l’acquisition de visiteurs.

Les moteurs de recherche, de leur côté, comptaient pour 45% de la fréquentation du site des Echos (proportion similaire bien que moindre pour Le Monde). Quant aux autres outils des géants de la tech, ils peuvent aussi avoir un rôle prépondérant : « Apple News, c’est vital pour les sites média, ça peut être 20 % à 30 % du trafic sur une journée », nous explique M. D., responsable des réseaux sociaux et de l'acquisition d'audience au sein du journal économique, en parlant de la revue de presse (ou « agrégateur ») proposée en natif sur iPhone.

Les quelques géants du web captent au passage la valeur créée par la presse. Par ailleurs, leur curation des contenus traduit une vision de la liberté d’expression encore trop souvent en contradiction avec les normes de la communauté dans laquelle ils sont déployés, quand ils n’encouragent pas la polarisation politique ou la propagation de fausses informations. Avec leur modèle économique fondé sur le ciblage publicitaire, la recherche de la vérité en pâtit immanquablement. Tous les médias traditionnels, bien sûr, ne sont pas des archanges de la raison à la poursuite du plus noble des savoirs. Loin de nous d’ailleurs l’idée de céder au mythe (Vauchez, 2019) de l’objectivité journalistique qui pourrait soi-disant être atteinte grâce aux grandes masses de données maintenant à disposition.

Cependant, et c’est l’argument central de cet article, les biens propres à la sphère des plateformes internet prédominent aujourd’hui dans la sphère de la presse au point que cette première exerce sur cette seconde une tyrannie. Le grief va même plus loin, puisque nous dirons que les plateformes agissent comme des juges impériaux, non seulement dans la sphère de la presse, mais au sein même de la nation où elles sont utilisées. Ces phénomènes étant rendus possibles par une perméabilité incontrôlée entre les différentes sphères mentionnées.

Nous aimerions analyser cette situation avec l’aide de Michael Walzer, principalement grâce à son ouvrage Sphères de justice (1983). Nous recourrons notamment à sa définition de la notion de tyrannie développée dans ce livre ou encore à celle de juge impérial, abordée dans les Tanner Lectures de 1985. Les concepts de perméabilité ou encore de logique de sphère sont des ajouts de notre part à son cadre théorique.

Nous reviendrons sur les solutions suggérées jusqu’à présent, puis évoquerons la nôtre : une ouverture contrainte et régulée des procédés de curation à une pluralité d’acteurs, à la presse en particulier. Par exemple, la possibilité pour une entité journalistique de brancher son propre algorithme de recommandation sur une plateforme. Paradoxalement, pour réduire la tyrannie d’une sphère sur une autre, il ne faut pas forcément annihiler son influence, mais définir leur articulation et encourager d’autres interactions, d’autres perméabilités.

Walzer et les sphères de justice

Clôture et perméabilité des sphères

Sphères de justice est l’un des ouvrages phares de Michael Walzer. Le philosophe américain contemporain y présente une théorie philosophico-politique fondée sur l’idée « d’égalité complexe ». Ce concept s’oppose à « l’égalité simple » qui propose une répartition égale de tous les biens (Walzer cible Marx plus ou moins explicitement). L’égalité complexe s’oppose également et surtout à la tyrannie, a fortiori à une tyrannie qui serait induite par une égalité simple. L’égalité complexe postule que plusieurs sphères de la vie humaine coexistent dans notre société, chacune ayant des biens propres. Par exemple, dans la sphère de la religion, la grâce sera un bien propre. La tyrannie, dit Walzer, commence lorsque les sphères perdent leur autonomie les unes par rapport aux autres et que les biens de l’une d’entre elles permettent d’acquérir les biens d’une autre à tel point que cette première sphère en vient à « dominer hors de son ordre » (Walzer, 1983, p. 43). L’auteur s’approprie ici les mots de Pascal (1669, Br. 244) qui représentent un leitmotiv pour délimiter les sphères de justice.

Car la tyrannie existe lorsque l’accès aux biens de chaque sphère n’est plus possible par la logique propre à chacune d’entre elles. Walzer n’emploie toutefois pas le terme de « logique », que nous entendons ici par « raison » ou « rationalité », c’est-à-dire ce qui permet de parvenir aux fins – aux biens – désirées, ce qui définit les moyens acceptables et les règles fondamentales à respecter. « Tout bien social ou tout ensemble de biens sociaux constitue pour ainsi dire une sphère distributive à l’intérieur de laquelle certains critères et dispositifs sont appropriés. » (Walzer, 1983, p. 32)

Or, il y a dans nos sociétés, nous dit-il, des conditions d’accès à ces biens qui doivent reposer sur une égalité en droit. Chacun doit pouvoir prétendre les obtenir selon la logique de chaque sphère. Quand une sphère prédomine sur une autre, ces conditions ne peuvent plus être rencontrées.

Selon lui, il n’y a pas de biens premiers. Par ailleurs, les biens sont considérés collectivement comme des biens, et non vis-à-vis du bien en soi. Il n’y a pas moyen d’aller plus loin que cette définition : un bien est ce qui fait consensus comme bien. Ensuite, « les répartitions sont justes ou injustes relativement aux significations sociales de ces biens » (Walzer, 1983, p. 30). Quelles sont donc ces « significations sociales » ? Il s’agit de ce qu’il est acceptable ou non de faire avec les biens ; Walzer cite en exemple la charge ecclésiastique (un bien) qui est incompatible avec le péché de simonie (la volonté de vendre ou d’acheter un bien spirituel tel que la rédemption). L’argent en tant que bien possède sa propre sphère, il répond à ses propres règles, à sa propre logique, et il ne saurait devenir prédominant dans la sphère du religieux. À noter que Walzer se veut dans une démarche descriptive, et non pas prescriptive, des valeurs3.

Très rapidement, on comprend toutefois que les sphères ne peuvent pas demeurer sourdes les unes aux autres. Par exemple, la sphère de l’éducation et celle de la famille ne sont pas entièrement dissociées bien qu’elles doivent garder leurs distances. La première vise comme biens l’enseignement de vérités tout autant qu’une égalité entre les élèves et offre ainsi « une monnaie courante d’échange de la vie politique et sociale » (Walzer, 1983, p. 287). La seconde vise par contraste d’autres biens tels que l’affection, qui trouve parfois son incarnation encore dans d’autres biens comme des dons, voire l’attribution d’une charge publique par népotisme au risque par conséquent de compromettre la sphère de l’éducation. Si le poids de la famille est prédominant, il en viendra à accentuer la reproduction sociale au détriment même du rôle attribué à l’éducation. L’éducation doit engendrer une « égalité dans la citoyenneté » (Walzer, 1983, p. 293). Elle s’oppose dans tous les cas à la possibilité d’un monopole des charges, et particulièrement des charges publiques, par certaines catégories de la population. En d’autres termes, l’éducation ne doit pas être l’instrument de la reproduction sociale, mais elle n’en demeure pas moins à l’écoute des familles. Car ces sphères ne peuvent pas s’ignorer totalement. « L’enfant qui n’est rien d’autre qu’un élève n’existe pas ; il faudrait le créer, et cela ne pourrait se faire, j’en ai peur, que dans une société tyrannique. » (Walzer, 1983, p. 303)

L’affection portée par les parents risquerait en effet d’être ainsi bâillonnée.

L’autonomie des sphères n’est jamais que relative justement pour éviter la tyrannie ; une fermeture hermétique permettrait malheureusement à une d’entre elles de devenir prédominante sur les autres. Il y a ainsi une perméabilité des sphères les unes aux autres : « Nous pouvons rechercher, tout au plus, une autonomie relative […] il nous faut mettre l’accent sur la réduction de la prédominance. » (Walzer, 1983, p. 32)

Cette dernière maxime doit à notre avis guider notre réflexion dans la conception de nouvelles normes au sein du champ de l’intelligence artificielle (IA). Il faut pour cela transposer l’analyse de Walzer à la sphère des plateformes et à celle de la presse. Si l’ouvrage de Walzer a déjà permis de penser les nouvelles prédominances induites par internet, nous espérons toutefois proposer ici une nouvelle approche en ce qui concerne l’univers de l’information généraliste.

Une problématique esquissée

Parmi la littérature s’inspirant de Walzer pour penser les conséquences sociétales des plateformes internet, nous pouvons citer Guillaume von der Weid (2017, p. 521-529). Il regrette par exemple que, au sein des réseaux sociaux, « toute séparation objective, toute hiérarchie, […] ont été abolies ». Il déplore la perméabilité des types de discours, et donc des sphères auxquels ils renvoient, pourrions-nous dire. Il s’étonne notamment que des avocats tweetent durant les audiences. L’auteur invite ainsi à « remettre de l’espace entre "parole institutionnelle" et "parole de débat" ». Von der Weid est d’abord préoccupé par le manque de retenue qui s’observe sur les réseaux alors que la justice demande de pouvoir faire son travail dans la sérénité. Il ne plaide pas cependant pour une fermeture hermétique des sphères entre elles, mais souhaite qu’elles trouvent une « bonne distance » et invoque Walzer à cette fin.

Tamar Sharon (2021) se penche, quant à elle, sur l’enjeu de ce qu’elle appelle un « empiètement » [encroachment] d’une sphère sur une autre, et se concentre davantage sur Walzer. Le propos de Sharon vise à pallier un déficit normatif observé dans la simple opposition entre le marché et ce qui doit s’en distinguer (et en être préservé). Elle considère que l’approche walzerienne permet d’offrir des ressources critiques face à des entreprises qui revendiquent des valeurs allant aujourd’hui au-delà de celles du marché, en particulier dans le domaine de la santé. Parce que les plateformes ne se contentent plus de plaider pour l’utilité et la liberté (biens propres à la sphère du marché), mais aussi pour le bien commun et la démocratisation du savoir médical, par exemple. Il n’est ainsi plus satisfaisant d’opposer le marché à une ou des sphères. Si l’on souhaite conserver la possibilité de critiquer la démarche des géants des nouvelles technologies, il est préférable de recourir à l’approche plurielle de Walzer.

Avec la Googlisation de la santé et d’autres secteurs de la société, dont l’éducation, l’information journalistique, l’urbanisme, nous pouvons avoir à faire face à de nouvelles transgressions des sphères connues existantes, de même qu’à des transgressions des sphères nouvelles et émergentes, auxquelles une approche préoccupée par la marchandisation et la commercialisation n’arrive pas assez à nous sensi¬biliser4. (Sharon, 2021)

Nous souscrivons parfaitement à cette thèse qui ne centre toutefois pas l’analyse sur la question de la presse.

Des réseaux sociaux devenus médias d’information

La prédominance du marketing

Le développement des algorithmes de recommandation a été rendu possible grâce aux progrès de l’IA. S’il faut comprendre dans cette discipline la simulation de « tout aspect de l’apprentissage ou autre caractéristique de l’intelligence », selon la profession de foi de la conférence de Dartmouth, en 1956, qui a façonné le terme, nous aimerions toutefois nous restreindre à deux notions plus spécifiques qui sont des sous-ensembles de l’IA. Premièrement, l’apprentissage automatique, qui est une technique permettant à un logiciel d’adopter par lui-même les règles pour parvenir à une fin fixée par un humain. Des règles qui sont définies lors d’une phase d’entraînement au cours de laquelle des exemples sont soumis à la machine, elles peuvent ensuite rester figées ou continuer à se modifier lors de la mise en production (phase d’inférence). Deuxièmement, les algorithmes de recommandation (simplement appelés « algorithmes » dans ce texte), qui représentent les règles produites par ce processus d’apprentissage automatique, mais pas seulement puisqu’un algorithme peut tout à fait être paramétré « à la main ». Rappelons qu’un algorithme est un modèle mathématique dont le rôle est de traiter des données en entrée pour en extraire un résultat en sortie (Turing, 1937, 1938). Dans un objectif de curation sur une plateforme internet, il sera souvent mis au point à travers un processus d’apprentissage automatique.

Les géants du web parviennent ainsi à hiérarchiser finement l’information proposée à leurs utilisateurs. La logique de ce phénomène répond à un problème simple auquel ils ont été confrontés : la monétisation. Les plateformes internet ont d’abord proposé un modèle gratuit et quasiment bénévole avant de devoir répondre à l’impératif de rentabilité de toute entreprise privée (Zuboff, 2019). Ils se sont alors rabattus sur la vente d’espaces publicitaires et l’exploitation des bases de données à leur disposition – celles de leurs utilisateurs – pour offrir un ciblage efficient auprès de leurs clients potentiels.

A la question « Qu’est-ce que Google ? », Larry Page, cofondateur de l’entreprise, aurait répondu dès 2001 : « Si nous avions une catégorie, ce serait les informations personnelles » (Douglas, 2011). Du côté de Facebook, son PDG et cofondateur, Mark Zuckerberg, a tenu des propos qui marquent autant par leur exemplarité que par leur ambiguïté, en 2007, lors du lancement de Facebook Ads, le service de publicité de la firme : « Depuis les cent dernières années, les médias ont été poussés vers les gens, mais les marketers vont prendre maintenant part aux discussions. Et ils vont le faire en utilisant les graphs sociaux de la même manière que nos utilisateurs5. » (Facebook, 2007)

Autrement dit, les algorithmes permettront le ciblage publicitaire et les annonceurs auront une place à part entière dans le fil d’actualité. La confusion volontaire ou non autour du terme « médias » est aujourd’hui lourde de conséquences : il semble ici employé pour désigner un message quelconque à vocation informationnel ou publicitaire. Or, offrir au marketing un droit de cité dans le flux, c’est répondre à la logique des annonceurs et non plus à celle des utilisateurs ni à celle de la presse (ce dont il n’a jamais été question jusqu’à récemment, voir point 3.1). Mark Zuckerberg propose cela sans considérer que le marketing puisse acquérir une influence telle qu’il en vienne à dominer la sphère de l’information. Un écueil déjà bien connu des médias traditionnels qui n’ont pas attendu l’apparition des plateformes internet pour s’abîmer dessus.

Jürgen Habermas, en 1962 (ch. VI), avait déjà identifié cette tendance de la presse à transformer la sphère publique en simple relai de la société de consommation au détriment de la conversation rationnelle et plus largement de la démocratie. Ce péril, qui prend souvent la forme du sensationnalisme, a justifié dans plusieurs pays des politiques en faveur d’une information d’intérêt général au cours du XXe siècle. Mais des médias traditionnels font aujourd’hui le choix de se plier aux exigences des algorithmes et retombent ainsi dans ce travers qui a malheureusement pour conséquence de figer le débat politique dans des postures radicales. Il suffit de penser au sort du très sérieux Chicago Tribune qui fut transformé en tabloïd au cours des années 2000 et dont la ligne éditoriale fut grandement influencée par le service marketing. Cette stratégie s’inscrivait dans une volonté de fournir « des produits focalisés sur l’intérêt des consommateurs et la demande en tant qu’opposés à ce que les citoyens doivent savoir », d’après un document interne (Folkenflik, 2011, ch. 6).

Les plateformes comme juges impériaux

La ligne de Mark Zuckerberg définie en 2007 ne se souciait pas de l’histoire. Une ligne qui ne poserait pas problème aujourd’hui si le poids des plateformes du groupe, nouvellement baptisé Meta, dans la fréquentation des sites de presse tout autant que dans l’accès à l’information n’était pas aussi important. Selon un sondage mené au niveau mondial (AFP, 2020), 72 % des répondants utilisent les réseaux sociaux pour s’informer, plus que via les sites de presse en accès direct (61 %). La télévision arrive encore en tête, mais de peu (74 %).

De fait, la sphère des plateformes de recommandation prédomine aujourd’hui sur le monde de l’information journalistique au point d’y exercer une forme de tyrannie. Lorsque Facebook a suspendu les pages de médias australiens (mais aussi du ministère de la Santé et de l’agence de météorologie), Josh Frydenberg, ministre des Finances, a déclaré que cette mesure prouvait « [l’]immense pouvoir économique » (ABC News Australia, 2020, 3 : 13) des plateformes et qu’elle était « heavy-handed » (2 : 42), ce qui peut être traduit par « autoritaire » ou plus simplement par « brutale ». Il s’agissait pour le géant américain de faire pression sur des négociations concernant une rétribution des acteurs de la presse de la part des plateformes.

Au mois d’août 2021, Facebook a fermé le compte d’un groupe de recherche rattaché à New York University et de plusieurs de ses membres qui s’intéressaient à la diffusion des publicités politiques sur le réseau social. Selon la firme américaine, les chercheurs n’auraient pas respecté les conditions générales de la plateforme et auraient procédé à des collectes de données remettant en cause le respect de la vie privée des utilisateurs (Clark, 2021). Elle invoque notamment une injonction de la Federal Trade Commission, l’institution ayant toutefois dénoncé depuis cette interprétation (Levine, 2021). Un des chercheurs, Damon McCoy, a ainsi regretté que Facebook puisse « dicter qui peut enquêter sur ce qu’il se passe sur la plateforme6 » (Knight First Amendment Institute, 2021).

Facebook endosse dans ces circonstances les habits d’un juge impérial, comme le décrit Walzer dans les Tanner Lectures de 1985 : « Il dérive une sorte d’autorité critique de la distance qu’il établit […] Il se situe à l’extérieur, dans quelque endroit privilégié, où il a accès à des principes "avancés" ou universaux – et il les applique avec une rigueur (intellectuelle) impersonnelle7. » (p. 33)

Lorsque Facebook censure des images telles que L’Origine du monde de Gustave Courbet (R. A., 2018) ; quand Instagram ou Twitter suppriment des messages de plusieurs comptes féministes qui posent la question « Comment fait-on pour que les hommes arrêtent de violer ? » (Décugis et Pham-Lê, 2021) ; ou quand ces mêmes réseaux sociaux, ainsi que YouTube, semblent encore trop peu réactifs (UEJF et al., 2020) aux signalements pour propos racistes, antisémites et homophobes, alors ces plateformes agissent selon des normes qui leur sont propres et qui ne sont pas en adéquation avec celles de la République française. Leurs jugements sur tous ces cas de figure relèvent de ceux d’un juge impérial.

Les conséquences de cette tyrannie – ou du moins de cette prédominance –, sont non seulement une captation et une exploitation de la valeur produite par les journalistes, mais aussi une réécriture des normes propres à une communauté (Badouard, 2021b) autant, comme nous allons le voir, qu’une tendance à la polarisation de l’espace public ou la propagation de fausses informations. Cela parce que les biens propres aux sphères des plateformes internet entrent en conflit avec ceux des médias traditionnels.

Polarisation et désinformation

Concernant la polarisation du débat public, les réseaux sociaux semblent plus concernés que les moteurs de recherche (ces derniers affichent même des résultats moins polarisés que la navigation directe vers les sites de presse) selon une étude de Ro’ee Levy (2021). Il constate par ailleurs le phénomène suivant :

Quand un site de presse est consulté via Facebook, 57% des individus consomment des informations qui sont en moyenne plus conservatrices que le Wall Street Journal ou plus à gauche que le Washington Post, et lors de connexions à des médias en ligne par d’autres biais, 39% des sujets consomment de tels sites partisans.

L’étude montre entre autres que l’exposition aux médias défendant des vues opposées aux participants [counter-attitudinal] entraîne une légère réduction de leur polarisation. Une précédente enquête (Allcott et al., 2021) avait même souligné que l’effet était plus prononcé avec une déconnexion de Facebook durant quatre semaines (ce qui ne saurait toutefois représenter une solution à long terme).

Concernant la désinformation, une étude du Pew Research Center (Mitchell et al., 2021, p. 34-40) menée aux États-Unis, établit le constat suivant : « Les Américains qui consultaient en priorité les actualités politiques via des médias sociaux avaient plus de probabilités d’avoir entendu des propos ou théories non prouvées. »

Il s’agissait par exemple de thèses selon lesquelles la vitamine C avait un effet préventif sur le Sars-CoV-2 ou sur un lien entre la pandémie et la 5G. Selon une autre enquête de l’organisation AlgoTransparency (Faddoul et al., 2020), les contenus conspirationnistes, qui défendent la thèse de la Terre plate ou que l’homme n’a pas marché sur la Lune, représentaient à début 2020 environ 3 % des recommandations automatiques sur YouTube. C’est moins qu’en 2018 (ce chiffre s’élevait alors à 10 %), mais encore beaucoup, selon les auteurs : « Compte tenu de la masse de données à sa disposition et de ses ressources informatiques, […] YouTube est techniquement capable de détecter les sujets conspirationnistes avec une plus grande pertinence. »

Une analyse récente d’un groupe de chercheurs dont les comptes ont été suspendus par Facebook (Edelson et al., 2021) a mis en évidence que les publications sur ce réseau social ainsi que sur Instagram de la part de médias aux extrêmes, particulièrement ceux à l’extrême-droite et qui diffusent de fausses informations, connaissent proportionnellement à leur nombre d’abonnés beaucoup plus d’engagement que les autres. Il est cependant à noter que les médias d’autres bords politiques qui propagent des fausses informations rencontrent moins d’engagement que ceux jugés fiables.

Ces phénomènes de polarisation et de désinformation sont en partie la conséquence de la conception des algorithmes de recommandation. Celui de YouTube a été façonné « pour garder les gens sur le site plus longtemps », selon les propos d’un ancien programmeur de la firme cité par le Wall Street Journal (Nicas, 2018, 4:10). Cet objectif de rétention de l’attention a donné d’ailleurs naissance, il y a maintenant une dizaine d’années, à la discipline de la « captologie » (Schrage, 2020, p. 163-164 ; Fogg B. J., 2009). La lanceuse d’alerte Frances Haugen est récemment allée dans le même sens en parlant du modèle de son ancien employeur, Facebook : « Il est optimisé pour obtenir de l’engagement » (CBSnews, 2021, 5 : 25). Ce qui amène la firme, selon « ses propres recherches » internes, à mettre en avant « du contenu qui est haineux, qui est clivant, qui est polarisant, [car] c’est plus simple d’inspirer de la colère que d’autres émotions8 ». Selon les documents qu’elle a transmis au Wall Street Journal (Scheck et al., 2021 ; Purnell et Horowitz, 2021), il apparaît que l’entreprise était au courant des difficultés non seulement à repérer les contenus illicites et incitant à la haine, mais aussi à les dépublier et à en réduire la viralité.

La question à laquelle nous devons répondre si nous désirons une société moins divisée, plus ouverte au dialogue, mais également si nous voulons émanciper la presse des contraintes des plateformes et lui éviter de se vautrer dans ses travers est : quelle est l’alternative ?

L’analyse des Sphères de justice nous a permis de mettre en évidence la manière dont un phénomène peut devenir tyrannique et ainsi susciter en nous un sentiment d’injustice9. L’œuvre de Michael Walzer est également susceptible de nous offrir une piste théorique pour trouver une solution pratique.

Donner les clefs à la presse

Si nous regrettons la prépondérance des biens provenant de la sphère des plateformes dans celle de la presse, peut-être devrions-nous offrir davantage de poids aux biens propres à la sphère de la presse dans celle des plateformes, c’est-à-dire à :

– l’information d’intérêt général ;

– la vérification des faits ;

– le recoupement des sources ;

– le souci du lecteur ;

– la sanctuarisation de la rédaction vis-à-vis du département marketing ;

– la sanctuarisation de la rédaction vis-à-vis des actionnaires ;

– la critique argumentée ;

– le débat contradictoire ;

– la pluralité des lignes éditoriales ;

– le respect de la liberté d’expression et de ses limites prévues par la loi.

Autant d’idéaux qui ne sont jamais parfaitement acquis, mais qui produisent pourtant une logique propre pour être atteints et qui sont négligés par les plateformes.

Le problème n’est pas tant, selon nous, la perméabilité des sphères, que l’absence d’articulation réglementaire entre elles, d’un protocole qui permettrait d’éviter à l’une d’elles de prédominer. L’idée que nous souhaitons défendre pour le cas d’usage des plateformes internet et des médias est donc la suivante : il faut donner accès aux acteurs de la presse traditionnelle aux algorithmes de recommandation sur les sites qui exploitent déjà leurs contenus. En d’autres termes, il faut permettre aux entités journalistiques d’implémenter leurs propres modèles de hiérarchisation de l’information sur les plateformes. Plusieurs solutions ont toutefois été envisagées précédemment.

Les propositions précédentes

La loi Avia

En France, la loi visant à lutter contre les contenus haineux sur internet, dite loi Avia, a été retoquée et vidée de sa substance par le Conseil constitutionnel. La version finale a finalement été promulguée le 24 juin 2020 (Loi N° 2020-766). Elle prévoyait, dans sa version initialement adoptée par l’Assemblée nationale, d’exiger des plateformes un retrait ou de rendre inaccessible, dans les 24 heures après son signalement, « tout contenu contrevenant manifestement » (Assemblée nationale, 2020, art. 1-9) aux dispositions prévues par la loi notamment contre : les provocations à la haine, à la violence ou au vol, la négation de crimes contre l’humanité, le harcèlement sexuel, la pédopornographie, l’apologie du terrorisme, les messages à caractère violent incitant à la pornographie ou aux jeux dangereux visant les mineurs (comme le « jeu du foulard »). Une mesure censurée par le Conseil constitutionnel qui s’inquiétait des entraves à la liberté d’expression qu’elle pourrait entraîner, le délai indiqué n’étant pas de nature à évaluer justement la situation : « Compte tenu des difficultés […] d'appréciation du caractère manifeste de l'illicéité des contenus signalés et du risque de signalements nombreux, le cas échéant infondés, un tel délai est particulièrement bref. » (Conseil constitutionnel, 2020)

La loi Avia souffrait, à notre sens, d’attaquer le problème de la publication des contenus et non de leur diffusion. Bien qu’il ait été envisagé d’autoriser le Conseil supérieur de l’audiovisuel à auditer les « principes et méthodes de conception des algorithmes » (Assemblée nationale, 2020, art. 3-18), la hiérarchisation n’était pas le cœur du sujet. Or, une première étape serait déjà de garantir que les contenus visés ne soient pas encouragés par le modèle informatique, voire qu’ils puissent être « enterrés » (c’est-à-dire sans possibilité de remonter la hiérarchie du flux), le temps de juger de leur illicéité. Une pratique déjà mise en œuvre par certaines plateformes et désignée par le terme de « shadow ban » (Badouard, 2021b), qui n’est pas sans susciter des critiques justement parce que les géants du web sont les seuls maîtres des algorithmes.

La loi n’adressait que la question du message et pas celle de sa viralité. Elle ne se souciait pas non plus de la captation de la valeur journalistique, alors que ces sujets nous paraissent indissociables.

Les droits voisins

Pour assurer aux entités de presse une rétribution en échange de l’utilisation de leurs contenus sur les plateformes, les grandes entreprises du numérique ont convenu de verser ce que nous appelons maintenant des « droits voisins », conformément à une directive européenne (Directive UE 2019/790, art. 15).

Sa transcription dans le droit français (Loi N° 2019-775) indique que les courts extraits ne sont pas concernés, mais elle ajoute une exception : lorsque le texte présenté par la plateforme « se substitue à la publication de presse elle-même ou dispense le lecteur de s'y référer » (art. 2). Les vignettes reprenant simplement le chapeau d’un article, ou tout extrait permettant de répondre à une question formulée par l’internaute, sont donc susceptibles de donner lieu à rétribution.

En France des négociations semblaient avoir abouti au début de l’année 2021 entre Google et les médias : l’accord prévoyait un paiement de 76 millions de dollars du géant de Mountain View sur trois ans à 121 entités de presse (Rosemain, 2021). S’il n’est pas remis en cause, cependant, l’Autorité de la concurrence (ADLC) a sanctionné le géant américain par une amende de 500 millions d’euros en juillet 2021 (21-D-17 du 12 juillet 2021). « L’Autorité estime que Google a manqué à son obligation de négociation de bonne foi », écrit l’ADLC. Le reproche principal porte sur la tentative du moteur de recherche d’inclure « sans valorisation financière spécifique » un partenariat avec un nouveau service nommé Showcase que nous évoquerons dans un instant. Finalement, un dernier rebondissement est intervenu en novembre de la même année : l’Agence France Presse (AFP) a signé un accord pour la rémunération de ses contenus avec Google en excluant Showcase. Le moteur de recherche était, à l’heure du bouclage de cet article, encore en négociation avec l’ Alliance de la presse d’information générale (APIG), le Syndicat des éditeurs de la presse magazine (SEPM) et la Société des auteurs, compositeurs et éditeurs de musique (SACEM) (Benedetti Valentini, 2021).

Meta est plus avancé puisque le groupe s’est entendu avec l’AFP, Le Monde, Le Figaro et l’APIG sur une rémunération. Ceux-là auront la possibilité de participer à un nouvel outil, Facebook News, dont le lancement est prévu pour janvier 2022 (Le Monde avec AFP, 2021). De son côté, Microsoft a signé un accord avec des associations de médias européens comme gage de sa bonne volonté (Debouté, 2021).

Seulement, cette solution des droits voisins entretient les journaux dans une subordination algorithmique vis-à-vis des plateformes. D’autre part, elle ne s’attaque pas aux problèmes des incitations à la haine ou autres propos visés par la loi Avia. Comme cette dernière, les droits voisins n’envisagent pas que l’enjeu de la hiérarchisation de l’information soit lié à la propagation de contenus mensongers ou illicites, car ce n’est pas son objet.

Social Reader et Showcase

D’autres initiatives venant des plateformes cherchent ou ont cherché pourtant à réconcilier les sphères. En 2011, Facebook a lancé un nouveau genre d’application, Social Reader, qui permettait à ses utilisateurs d’accéder à des contenus de médias sans se rendre sur leur site, voire de consulter certains articles normalement payants. Les informations étaient recommandées non seulement en fonction de ce que partageaient les « amis » d’une personne sur le réseau social, mais aussi selon ce qu’ils lisaient. Le Washington Post fut le premier ainsi embarqué. Le programme avait d’ailleurs été conçu par une filiale du journal américain (Isaac, 2011). Malheureusement, l’expérience n’a pas porté les fruits escomptés et les Social Readers étaient déjà sur le déclin moins d’un an après leur lancement (Herman, 2012). Il se trouve que Facebook, à peu près au même moment, a modifié son algorithme, ce qui a semble-t-il affecté la pérennité des Social Readers (Antheaume, 2012). Ce changement eut pour conséquence « d’enterrer » leurs publications. Enfin, il est possible que le fait de rendre visibles auprès de ses « amis » les articles consultés ait suscité des réticences chez des utilisateurs. La leçon à tirer de cette expérience est que si l’enjeu de l’algorithme de recommandation n’est pas pris en compte, les collaborations entre les géants du web et la presse risquent de rester au stade de vœux pieux. Le nouvel outil Facebook News, déjà déployé au Royaume-Uni, ne fera sans doute pas exception : il apparaît sous forme d’onglet sur l’application du réseau social, ce qui le distingue du flux principal – la similitude sur ce point avec les Social Readers est frappante. Quand bien même les internautes choisiraient délibérément de s’y connecter, la logique de curation du réseau social continuera à prédominer et la presse sera toujours contrainte de s’y conformer si elle souhaite être lue.

Google, de son côté, a lancé un nouvel outil au Royaume-Uni (Harris, 2021) et en Australie (Beddoe, 2021) dans le sillage de l’application des droits voisins. Showcase est censé être déployé dans d’autres pays, dont la France. Il offre la possibilité aux entreprises de presse de créer des flux, dont certains seront intégrés à l’application historique News, qui effectue déjà une curation des actualités. Des entités journalistiques seront donc bien à l’origine de la hiérarchisation de l’information sur leur flux Showcase, mais Google gardera la main sur son outil News. L’écueil est à notre avis le même que pour Facebook : la presse demeure écartée du flux principal, News en l’occurrence, dans la mesure où cette application est en plus connectée aux résultats du moteur de recherche historique. Showcase apparaît comme un sous-sous-produit de la firme. Quelle garantie les éditeurs auront-ils de voir leurs contenus remonter dans le fil News ou encore dans les résultats du moteur de recherche ? À la lumière de l’expérience des Social Readers, nous ne pouvons encore une fois que nous montrer particulièrement sceptiques sur l’intérêt pour la presse de se lancer dans ce type de collaboration.

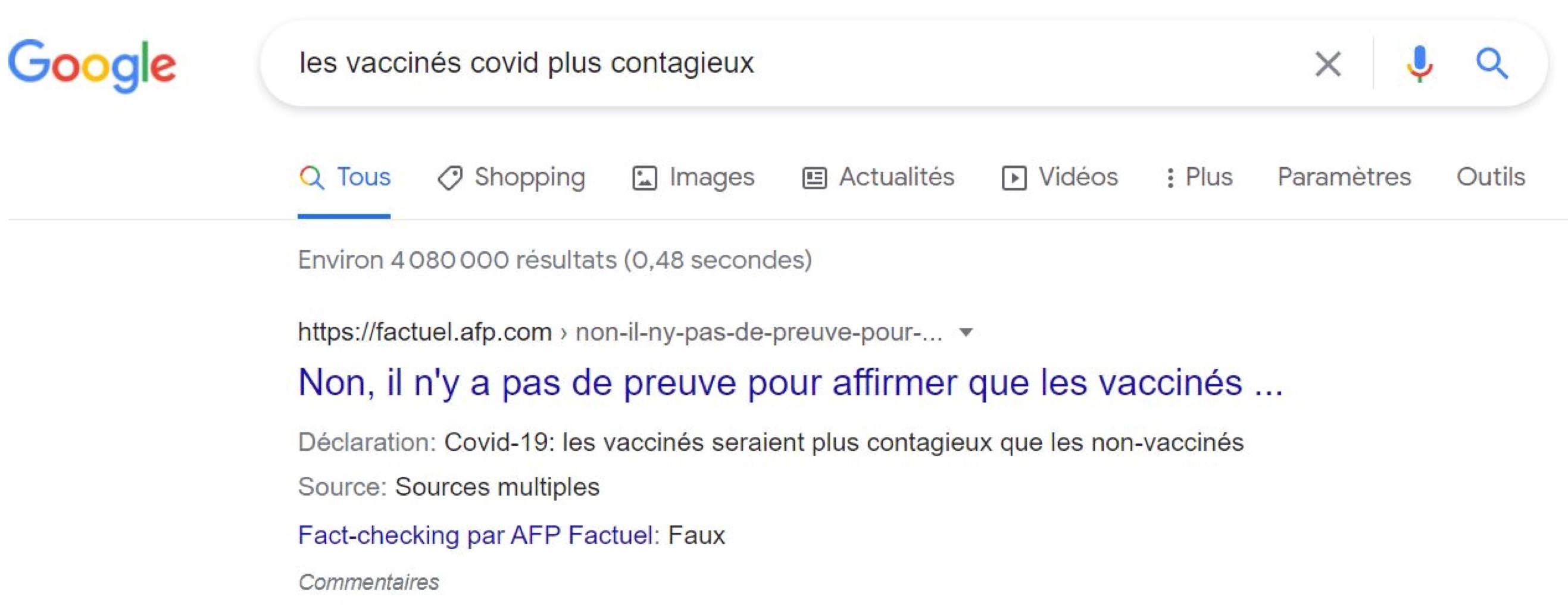

Quant à l’enjeu de la désinformation, il est à noter des efforts de Google : le moteur de recherche affiche une nouvelle indication « Fact-check » (Kosslyn et Yu, 2017), depuis 2016, pour les résultats des notions susceptibles d’être victimes de rumeurs ou de mensonges, et, depuis 2021, il en va de même sur Google Images (Cohen, 2020). La plateforme cite ainsi l’avis d’une source d’autorité sur le sujet (vrai/faux/trompeur/etc.). Par exemple, avec la requête sur le moteur classique10 « les vaccinés covid plus contagieux », le résultat donne un lien vers l’article de l’AFP Factuel « Non, il n'y a pas de preuve pour affirmer que les vaccinés contre le Covid-19 sont plus contagieux que les non-vaccinés », puis la mention « Fact-checking par AFP Factuel : faux » (Figure 1). Ironie de cette initiative, le site de l’AFP Factuel, la cellule de vérification de l’Agence France-Presse, a été conçu en partenariat avec Facebook (Lefilliâtre, 2019) (l’expérience reproduite sur Google le 27.11.2021 n’a toutefois pas permis de retrouver ce résultat ni d’autres, signe peut-être que ce dispositif a été retiré du moteur de recherche).

Figure 1. Résultat de requête sur Google.

De façon plus générale, il est important de souligner que les plateformes prennent au sérieux ces problématiques et améliorent effectivement leurs résultats (voir aussi CNCDH, 2021; Hagey et Horowitz, 2021), bien que de façon insatisfaisante. Par ailleurs, les décisions politiques nationales ou communautaires, qu’elles soient contraignantes ou non, pour lutter contre les propos illicites sont souvent suivies d’effets (Badouard, 2021a). Il ne s’agirait donc pas de croire que les États sont impuissants face à ces phénomènes.

Digital Service Act et Digital Markets Act

Deux textes ambitieux ont été proposés par l’Union européenne : le Digital Service Act (DSA) et le Digital Markets Act (DMA). Ils visent à encadrer plus strictement le secteur des grandes plateformes en ligne. Ces projets de « règlements » seront d’application immédiate s’ils sont adoptés par le Parlement, contrairement aux « directives » qui nécessitent une implémentation dans chaque droit national.

Concernant les propos illicites, le DSA invite les plateformes à les « retirer » ou les rendre inaccessibles « promptement » (art. 5-1), ce qui laisse une ambiguïté sur l’échéance. Même dans le cas d’une « injonction des autorités », la plateforme doit se contenter « d’informe[r] dans les meilleurs délais l’autorité émettrice de l’effet » (art. 8). Nous risquons alors soit de nous retrouver face au même écueil que la loi Avia, qui a donc été censurée à cause d’exigences trop pressantes, soit face à des sociétés qui traînent des pieds. Or, le pic de vues d’un contenu est souvent obtenu dans les premières 24 heures de sa mise en ligne.

Peut-être dans l’espoir de contrer leur viralité, les législateurs et législatrices ont cependant prévu à l’article 29 qu’il soit possible pour les utilisateurs d’agir directement ou indirectement sur la hiérarchie de l’information. Les « très grandes plateformes » (plus de 45 millions d’inscrits) seraient ainsi contraintes d’exposer « les principaux paramètres utilisés dans leurs systèmes de recommandation, ainsi que les options dont disposent les bénéficiaires du service pour [les] modifier ou [les] influencer ». Le texte prévoit en outre au moins une « option qui ne relève pas du profilage » : ce qui pourrait très bien être un affichage chronologique ou éditorialisé, de la même manière que le public ne reçoit qu’un seul flux d’information en écoutant une station radio. L’article 29 a le mérite d’offrir la possibilité de s’émanciper un peu des algorithmes de hiérarchisation de l’information internes aux plateformes, mais les modalités de mise en œuvre pour agir sur le modèle peuvent tout à fait demeurer complexes. Par exemple, si un acteur explique qu’il suffit à l’internaute de cliquer sur les contenus qu’il ou elle souhaite voir apparaître au fil de sa navigation, cela semble être « compréhensible » et « accessible », comme l’exige la loi, mais potentiellement inopérant. Qui en effet possède une telle patience et peut se flatter de cliquer sur les seuls contenus qu’il ou elle souhaite voir apparaître ? Le DSA n’envisage pas une obligation de rendre les paramètres modifiables, l’exigence minimale consiste simplement à dire comment il est possible de les « influencer ». Il n’y a par ailleurs qu’une seule autre « option » de hiérarchisation de l’information requise : autrement dit un seul système alternatif de recommandation à proposer par la plateforme, mais qu’elle a très bien pu concevoir elle-même. Celle-ci reste donc maîtresse en sa demeure.

Pourtant, le DMA exige une « interopérabilité » (52) avec des acteurs « tiers » (art. 6-1-(c)) de la part de ceux qui sont appelés les « contrôleurs d’accès », c’est-à-dire les mêmes « très grandes plateformes » du DSA (d’autres critères économiques peuvent être pris en compte). Au sens du DMA, ils représentent un « poids important », un « point d’accès majeur » ou détiennent une « position solide et durable » (art. 3).

Des fonctions additionnelles doivent pouvoir être implémentées sur lesdits « contrôleurs d’accès », sans que l’utilisateur soit obligé de passer par leur boutique propre d’applications. Cette disposition vise évidemment à éviter la création de positions anti-concurrentielles de la part d’un ou de quelques acteurs puissants (Apple avec son App Store notamment).

Nous pouvons en tirer comme interprétation que les « très grandes plateformes » sont des « contrôleurs d’accès » en ce qui concerne le journalisme. Elles représentent aujourd’hui un « poids important » dans l’accès à l’information, un « point d’accès majeur » pour se rendre sur les sites de presse, et bénéficient d’une position « solide et durable » depuis une dizaine d’années.

Notre proposition s’inscrit donc dans la ligne des textes européens, mais de manière toutefois plus contraignante et circonscrite au secteur de la presse. Nous espérons également qu’elle offrira une approche plus lisible auprès du grand public.

Des algorithmes de recommandation fournis par la presse

La solution que nous proposons a pour ambition d’aller au-delà de l’aspect pécuniaire tout en redonnant à la sphère de la presse le poids qu’elle n’aurait jamais dû perdre dans l’espace public. Concrètement, les entités journalistiques pourraient demander à chaque plateforme de recommandation de contenus à caractère informationnel un droit de brancher son propre algorithme de hiérarchisation.

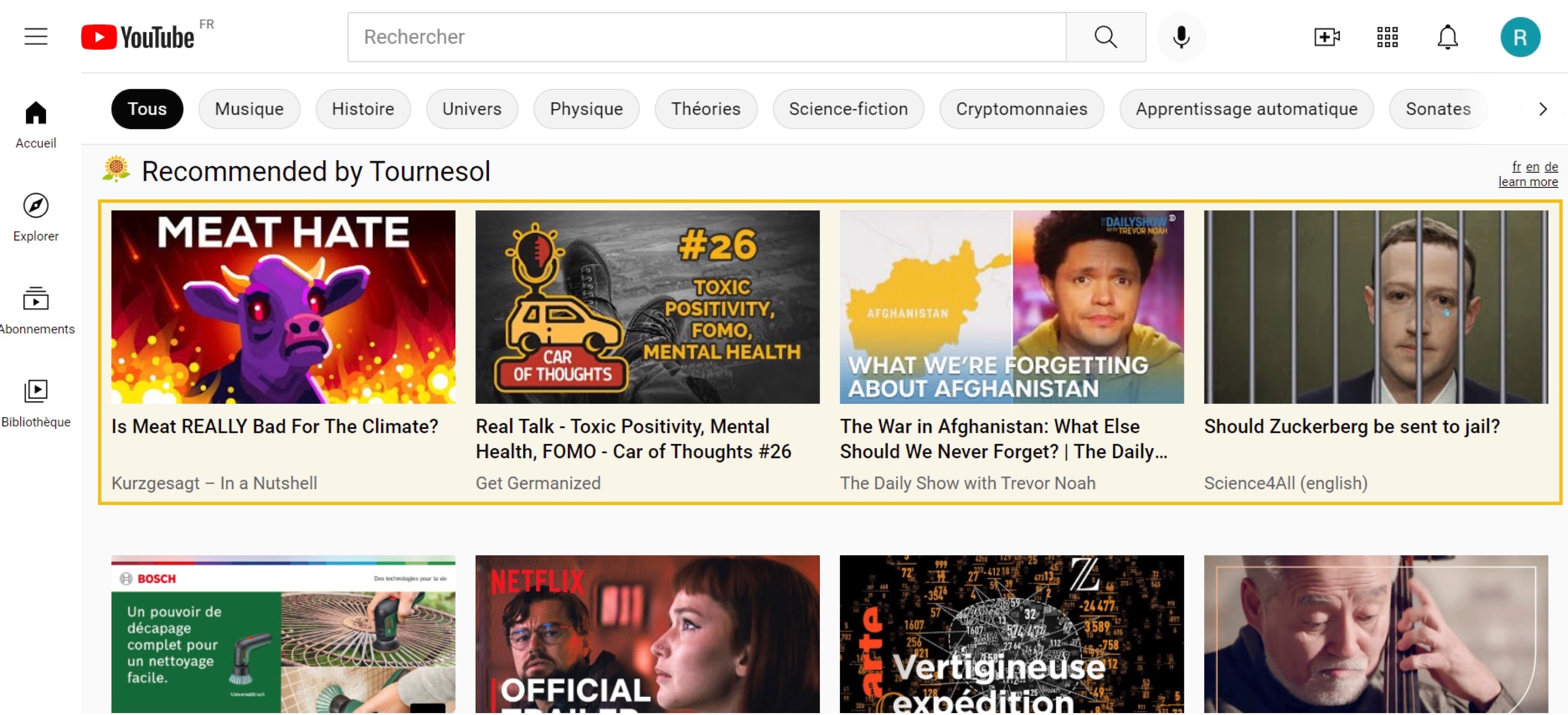

Figure 2. Exemple d’aménagement sur Twitter.

C’est, sur le plan technique, parfaitement envisageable et à vrai dire déjà en production. L’extension Tournesol (tournesol.app), lancée récemment, permet ainsi de modifier l’affichage des vidéos recommandées sur YouTube (Figure 3). Tournesol est cependant développé par une communauté et veut crowdsourcer sa hiérarchie, ce qui n’est pas l’objectif que nous présentons. Enfin, nous pouvons également mentionner le projet YouChoose (youchoose.ai), qui a reçu un financement Horizon 2020 de la part de l’Union européenne, et dont le but est d’ouvrir à de nouveaux « paradigmes » de curation. Son outil afficherait non seulement d’autres vidéos que celles préconisées par YouTube – pourquoi pas celles de Tournesol qui est intégré – mais aussi des liens vers des sites web externes. YouChoose serait représenterait ainsi un pas significatif vers l’ouverture à la concurrence des systèmes de hiérarchisation de contenu au sein même des plateformes. Nous aimerions toutefois qu’un cadre réglementaire fixe des bornes.

Avec notre solution, l’internaute pourrait choisir l’algorithme qu’il souhaite utiliser pour l’alimentation de son flux principal d’information ou bien comme moteur de recherche (c’est déjà le cas sur les barres de recherche des navigateurs), de la même manière qu’on choisissait autrefois une chaîne de télévision. La différence étant toutefois qu’un fil tiers ne serait pas amené à présenter exclusivement des contenus de son média. Les multiples « groupes11 » sur Facebook créés par des journaux – groupes sur lesquels tout internaute peut s’exprimer et poster des liens – ne restreignent pas les publications aux seuls articles de la rédaction. Ces expériences montrent que les entités de presse peuvent ouvrir leur fil à d’autres contenus. Il aurait certes tendance à mettre en avant des messages et des actualités en correspondance avec leur ligne éditoriale, mais c’est après tout ce qu’on leur demande.

Figure 3. L’extension Tournesol.

Nous ciblons bien trois secteurs. Premirement, celui des réseaux sociaux (Facebook, Twitter, Instagram, TikTok, etc.). Deuxièmement, celui des moteurs de recherche, dans la mesure où ils fournissent des contenus d’actualité. Il faut inclure Google News et les vignettes qui apparaissent dans les résultats du moteur historique de Google. Un moteur de recherche sur Wikipedia, sur Gallica ou Google Scholar ou bien dans le e-commerce n’a en revanche pas vocation à accueillir l’algorithme d’un éditeur de presse. Il s’agit d’autres sphères qui peuvent néanmoins s’inspirer de l’initiative que nous proposons. Google, Bing, DuckDuckGo ou encore Qwant sont cependant tous concernés puisque le service s’adapte en temps réel à l’actualité, via les vignettes en une, mais pas seulement. Les résultats classiques changent trop fréquemment pour ne pas avoir de conséquences sur la fréquentation des sites de presse. Troisièmement, enfin, nous visons les agrégateurs comme Feedly et Apple News.

Il est possible de se demander si les sites de certaines entités de presse n’agissent pas aujourd’hui comme des plateformes d’autant qu’elles peuvent aussi pratiquer une hiérarchisation automatique des contenus. Inversement, certaines plateformes peuvent tout à fait être considérées comme des entités de presse à partir du moment où nous admettons qu’elles fournissent un travail éditorial avec leur curation. Certes, il n’est pas exclu que les médias traditionnels soient aussi visés par notre proposition. Ils n’ont cependant aucune commune mesure avec les « contrôleurs d’accès » ou « très grandes plateformes » qui résument bien ce que nous entendons par « plateformes ». La qualité d’entité de presse pouvant être accordée à ces dernières (par la commission imaginée au point 3.4), elles seraient également éligibles à brancher leurs propres algorithmes chez leurs semblables.

Accès périodiquement aléatoire aux algorithmes (APAA)

À chaque première connexion d’un ou d’une internaute, la plateforme serait ainsi contrainte de demander quel algorithme il ou elle souhaite utiliser. Il conviendrait cependant de savoir ouvrir les lecteurs à des sites qu’ils ne consulteraient pas de leur propre initiative et qui ne correspondent pas à leurs opinions politiques. Nous suggérons ainsi que l’algorithme de recommandation change de façon aléatoire selon une certaine fréquence, toutes les cinq ou dix connexions par exemple. L’internaute aurait ensuite la liberté de revenir sur l’algorithme choisi initialement ou bien de rester sur celui qui lui a été attribué. Un procédé que nous proposons d’appeler ici « Accès Périodiquement Aléatoire aux Algorithmes » (APAA)12.

Ce genre de procédé est déjà utilisé pour « tester » les préférences des internautes, dans une perspective exploratoire. Il consiste à proposer au hasard de nouveaux types de contenus susceptibles d’être appréciés par les sujets, ce qui permet d’améliorer les recommandations : il faut de temps en temps élargir pour affiner. Il est connu sous le nom d’algorithme « bandits manchots13 » (Schrage, 2020, p. 145), mais son caractère aléatoire est conditionné : il s’agit toujours de satisfaire l’internaute in fine et d’obtenir le meilleur retour sur investissement. Qu’il porte le surnom des machines à sous dans les casinos n’est pas un hasard et résume bien le problème auquel il doit répondre : miser là où l’on est le plus sûr de gagner, mais avec un haut degré d’incertitude, ou tenter sa chance ailleurs ? Nous souhaitons par contraste que l’APAA s’inscrive plutôt dans un processus de découverte d’autres points de vue, sans essayer de capter à tout prix l’attention de l’internaute, sans viser un objectif exploratoire, mais informationnel, afin de favoriser l’ouverture d’esprit. L’APAA n’exclut cependant pas que sa logique puisse occasionnellement converger avec celle d’un algorithme bandits manchots, mais cela ne doit pas guider sa conception.

D’après l’étude de Levy (2021), il est tout à fait probable que l’utilisateur de la plateforme soit alors enclin à lire et partager davantage de contenus issus de médias opposés à sa tendance politique [counter-attitudinal]. Il a été constaté une augmentation de 79 % des visites vers de tels sites lorsqu’ils étaient proposés à une personne dans son flux Facebook (une fois, néanmoins, qu’elle avait été invitée à « aimer » un média considéré comme contraire à ses opinions [counter-attitudinal treatment]). On pourrait légitimement se demander s’il ne s’agit pas d’une attirance vers des propos qui paraîtraient cependant scandaleux ; l’indignation fait aussi recette sur les réseaux sociaux. Levy a toutefois comparé les données avec les partages sans commentaires (action qui laisse supposer une adhésion implicite au message). Il apparaît toujours dans ce cas que les nouvelles suggestions « avaient un effet significatif » sur le nombre de liens partagés. Autrement dit, exposer une personne à des contenus qui sont théoriquement en contradiction avec ses points de vue politiques l’entraîne pourtant à les consulter et les promouvoir.

Définition d’un organisme de presse

La question subsidiaire est de savoir qui peut prétendre être qualifié d’entité de presse et donc avoir une autorisation d’accès à la plateforme pour y implémenter son algorithme de recommandation. Dans un État démocratique, il est impensable de choisir qui a le droit de publier, mais peut-être pas qui a le droit de recommander chez autrui. La liberté d’expression n’est pas contredite du moment qu’il ne s’agit pas d’interdire la recommandation de contenus, mais d’encadrer ceux qui peuvent se déployer.

Nous faisons face à deux phénomènes assez différents pour fournir une distinction juridiquement fondée. D’un côté, il s’agit de « parler, écrire, imprimer librement », comme le stipule l’article 11 de la Déclaration des droits de l’homme de 1789, et nous pourrions ajouter « recommander ». D’un autre côté, il s’agit de discerner ceux qui ont le droit de soumettre des algorithmes de recommandation à des acteurs tiers de ceux qui ne le peuvent pas. Ce qui n’empêche pas la « libre communication des pensées et des opinions » et encore moins la création d’une plateforme de recommandation de contenus. À l’inverse, acquérir une position quasi-monopolistique et décider qui sera mis en avant, qui finira dans les limbes du web et qui n’aura pas droit de cité est davantage contraire au principe de la liberté d’expression, c’est pourtant la situation dans laquelle nous vivons.

Certaines entités pourraient ainsi figurer dans une liste reconnaissant leur intérêt pour la pluralité de la presse afin de leur accorder le droit de déployer leurs propres algorithmes de recommandation. Il existe déjà une telle liste, mais elle ne donne pas droit aux mêmes avantages : celle des organismes qui bénéficient des « aides directes à la presse ». Cette sélection pourrait servir également à autoriser l’implémentation des algorithmes de presse sur les plateformes internet concernées. Cela s’inscrirait parfaitement dans les missions existantes de ces subventions qui sont : « Le développement de la diffusion, la défense du pluralisme, la modernisation et la diversification vers le multimédia des entreprises de presse. » (Ministère de la Culture).

Le recours à cette liste serait d’autant plus pertinent pour prévenir une polarisation de l’espace public et la diffusion de propos illicites que les entreprises ayant été condamnées au cours des cinq dernières années pour incitation à la haine ou négation de crime contre l’humanité en sont exclues (du moins explicitement pour deux types d’aides visées par les décrets ici en note)14.

Ce serait en tout cas une première étape, car il reste encore à savoir quelle serait la place des journaux télévisés et des radios (qui peuvent déjà bénéficier de certaines aides). Rien ne semble s’opposer à leur offrir pareille possibilité. Nous pouvons alors envisager qu’une nouvelle sélection voie le jour, toujours sur le fondement des « aides directes à la presse », et en excluant les acteurs condamnés pour incitation à la haine ou négation de crime contre l’humanité. Pourquoi pas sous l’égide de la commission qui définit déjà aujourd’hui les entreprises éligibles aux subventions : la Commission paritaire des publications et agences de presse (CPPAP) qui réunit des représentants de l’État et des éditeurs. Pourquoi pas, encore, en partenariat avec la Commission de la Carte d'identité des journalistes professionnels (CCIJP). La carte de presse ne présente rien de contraignant et n’offre en théorie aucun droit supplémentaire (tout citoyen peut se revendiquer journaliste), mais les membres de la CCIJP permettraient dans une certaine mesure de prévenir d’éventuelles négligences quant à l’élaboration de l’algorithme et surveilleraient surtout que des journalistes, affiliés à la convention collective, sont bien associés à la conception.

Une telle disposition doit aller de pair avec une instance capable de retirer « l’agrément » si des manquements manifestes sont constatés, tels que la propagation répétée et accentuée de propos condamnés. Il pourrait même être envisagé que cet agrément soit retiré temporairement aux plateformes internet elles-mêmes – elles seraient alors contraintes soit d’afficher les algorithmes des acteurs tiers ou bien une classification chronologique.

Cette commission que nous appelons de nos vœux serait toutefois plus efficace si elle émergeait dès sa naissance dans un cadre européen. Le DSA a proposé la création d’arbitres agréés pour trancher les litiges sur les contenus exclus. Mais, comme le remarquent Pierre Auriel et Mathilde Unger (2021), « un tel système est faiblement contraignant », car ils « demeureront largement dépendants du réseau social ». Il convient, selon nous, de doter les autorités publiques d’une instance au pouvoir contraignant, pas nécessairement sur chaque contenu pris isolément, mais sur les systèmes de recommandation.

Conclusion

La presse s’est définie au fil d’un long processus historique qui a non seulement été bouleversé mais nié par les plateformes de recommandation de contenus d’actualités fondées sur un traitement automatisé, fût-il opéré avec l’aide active d’humains. La hiérarchisation de l’information est une tâche journalistique. Il serait inimaginable et inacceptable de voir s’afficher, même une fois de temps en temps, des propos racistes, antisémites, homophobes, ou encore des « théories » telles que celles de la Terre plate dans nos journaux. Nous les avons pourtant acceptés pendant des années sur des plateformes qui ont réussi à faire croire à leur absence de ligne éditoriale. Sundar Pichai, PDG de Google, a toujours maintenu que les résultats du moteur de recherche reflétaient le monde « de la manière la plus objective possible15 » (CNBC Television, 2018, 1:04 :25) et « sans biais politiques16 » (Pichai, 2020). S’il est maintenant communément admis que les médias ont une orientation politique, qu’elle est même savamment mesurée par les chercheurs, il semble encore possible de propager l’idée que les plateformes de recommandation de contenus journalistiques n’en ont pas. C’est bien ce que nous dénonçons dans notre texte, dans la lignée de plusieurs recherches récentes (Benjamin, 2019 ; Badouard, 2021b ; Girard, 2021 ; Mabi, 2021) qui plaident bien souvent aussi pour leur régulation. Choisir de montrer certaines informations, c’est toujours choisir de ne pas en montrer d’autres, c’est choisir un angle pour aborder un sujet. On comprend mal comment ceux qui choisissent de mettre en avant des contenus n’auraient pas également leur ligne éditoriale. Dès lors, la position oligopolistique des plateformes est en contradiction avec la pluralité exigée par la sphère de la presse. Briser ces positions dominantes est d’ailleurs une recommandation du Congrès américain (House Judiciary Committee, 2020) et nous espérons que notre proposition aille dans ce sens.

Il ne s’agit pas de demander la destruction des plateformes internet ni des algorithmes de recommandation librement conçus, mais leur régulation. « Il nous faut mettre l’accent sur la réduction de la prédominance » (Walzer, 1983, p. 32). Nous allons vivre avec ces innovations et il faut savoir aussi leur rendre gré d’avoir ouvert l’espace public, parfois même de l’avoir revivifié dans son caractère démocratique. Il faut reconnaître qu’elles nous ont permis de découvrir des médias que nous ignorions et dont nous ne saurions plus nous passer aujourd’hui, des autrices et des auteurs que nous suivons assidûment, des textes, des vidéos, des podcasts que nous chérissons. Elles ne doivent cependant pas conserver les positions prédominantes qui sont les leurs aujourd’hui sur les autres sphères et en particulier celle de la presse qui vit continuellement sous la menace d’une disgrâce algorithmique.

France Soir est tombé dans une telle disgrâce en 2021, lorsque Google a décidé de retirer le média français des sources pouvant figurer dans Google News et de fermer sa chaîne YouTube. Le site héritier d’un grand quotidien aurait enfreint le règlement en diffusant des informations erronées relatives à la pandémie de Sars-Cov-2, d’après l’avocat de France Soir (Henni, 2021). Cette initiative de Google peut à la fois susciter un sentiment de soulagement auprès des personnes qui s’inquiètent de voir le média français prendre un tournant complotiste, et en même temps engendrer une inquiétude sur le pouvoir absolu de la plateforme. Certes, ses décisions envers France Soir visent une information de meilleure qualité, mais l’événement met encore une fois en évidence son rôle de juge impérial, car elle possède un monopole sur le pouvoir de recommander. Peut-être que si ce choix avait émané de plusieurs entités et/ou d’une commission, l’aspect autoritaire n’aurait même pas été considéré.

Ces sanctions apportent de la crédibilité à Google quand l’entreprise dit vouloir lutter contre les fausses informations, mais l’événement doit en même temps inviter à une redistribution du pouvoir de curation.

Il souligne aussi la possibilité qu’une entité de presse devienne moins fiable que la plateforme elle-même. S’il était donné ce pouvoir de recommander à de nombreuses entités de presse, il ne fait aucun doute que certaines tomberaient dans les mêmes travers que les plateformes et qu’il faudrait un temps d’adaptation avant qu’un juste équilibre soit trouvé, de gré ou de force.

Il n’est enfin pas écrit d’avance que les extrêmes seraient atténués par une redistribution du pouvoir de recommander. Si nous avons déploré la polarisation de la société avec les plateformes, peut-être aussi que les individus les plus extrêmes sont davantage présents sur celles-ci. Dès lors, il n’est pas impossible que les médias les plus extrêmes continuent à attirer leur public qui est déjà présent sur internet. D’où l’importance d’exclure ceux qui propagent des propos illicites et de savoir apporter une dose d’aléatoire dans l’algorithme, la radicalité n’étant pas ici à éviter.

Rémy Demichelis est journaliste à Investir17 et doctorant à l’Université Paris

Nanterre (affilié à l’Institut de Recherches Philosophiques – IrePh).

Notes

1Au niveau mondial, individus de 16 à 64 ans.

2Données au début de 2021 directement transmises à l’auteur par Les Échos.

3Nous considérons toutefois qu’une réactualisation d’une description lui offre quand même une opportunité de devenir de nouveau prescriptive. Walzer, en lecteur de Hegel, considérerait peut-être que la distinction descriptif/prescriptif n’a pas lieu d’être. Le ton de son œuvre laisse d’ailleurs penser qu’il adhère à ces principes.

4« With the Googlization of health and other sectors of society, including education, news provision, and city planning, we may be facing new transgressions from existing known spheres as well as transgressions from new and emergent spheres that a focus on commodification and commercialization do not do enough to sensitize us to. » (traduction de l’auteur)

5« For the last hundred years media has been pushed out to people, but now marketers are going to be a part of the conversation. And they’re going to do this by using the social graph in the same way our users do. »

6« Allowing Facebook to dictate who can investigate what is occurring on its platform is not in the public interest. »

7« He derives a kind of critical authority from the distance he establishes […] He stands outside, in some privileged place, where he has access to “advanced” or universal principles; and he applies these principles with an impersonal (intellectual) rigor. »

8« It is optimizing for content that gets engagement, or reaction. But its own research is showing that content that is hateful, that is divisive, that is polarizing, it's easier to inspire people to anger than it is to other emotions. »

9Walzer n’est pas aussi explicite sur le surgissement du sentiment d’injustice, nous nous permettons d’interpréter plus avant son propos concernant cet aspect bien spécifique.

10Faite le 05.04.2021.

11« Le Club des boursicoteurs » par Capital ; « Les Echos Cryptoclub » ; « Le Club de lecture du Figaro » ; « Tout le monde des livres » par Le Monde ; « 20 Minutes Séries ».

12Nous proposons Frequent Randomized Access to Algorithms (FRAA) pour l’anglais.

13En anglais : multi-armed bandits.

14Décret N°86-616 du 12 mars 1986 instituant une aide aux publications nationales d’information politique et générale à faibles ressources publicitaires, article 3-1. Décret N°2004-1312 du 26 novembre 2004 relatif au fonds d’aide au pluralisme de la presse périodique régionale et locale, article 2. Cette exclusion a été rendu possible par le Décret N° 2015-1440 du 6 novembre 2015 relatif au soutien de l'État au pluralisme de la presse proposé par Fleur Pellerin, alors ministre de la Culture et de la Communication.

15« It is in our interest to make sure we reflect what's happening out there in the best objective manner possible. »

16« We approach our work without political bias, full stop. »

17Les opinions exprimées dans cet article appartiennent exclusivement à son auteur et ne reflètent en aucun cas celles de l’entreprise. Ce texte a été présenté pour la première fois dans une version simplifiée lors du séminaire L’Interprétation en acte (2020/2021), organisé par le Fonds Ricœur et l’EHESS.

Références

ABC News Australia (2021). Treasurer Josh Frydenberg and Communications Minister Paul Fletcher on Facebook. [Vidéo en ligne] YouTube.fr, 18.02.2021.

AFP (2020). Médias : les Français moins enclins à payer pour s’informer que la moyenne mondiale [dépêche]. [En ligne] FrenchWeb.fr, 27.10.2020.

Allcott, Hunt, Braghieri, Luca, Eichmeyer, Sarah, Gentzkow, Matthew (2020). The welfare effects of social media, American Economic Review 110(3). 629-676.

Antheaume, Alice (2012). Les Social Readers des éditeurs sur Facebook sont-ils désertés ? [article de blog]. [En ligne] Slate.fr, 14.12.2012.

Assemblée nationale (2020). Proposition de loi nº 388, adoptée par l’Assemblée nationale, en nouvelle lecture, visant à lutter contre les contenus haineux sur internet.

Auriel, Pierre et Mathilde Unger (2021). Les règles de la modération. Esprit, 479(1). 85-94.

Autorité de la concurrence (2021). Décision N° 21-D-17 du 12 juillet 2021 relative au respect des injonctions prononcées à l’encontre de Google dans la décision N° 20-MC-01 du 9 avril 2020.

Badouard, Romain (2021a). Modérer la parole sur les réseaux sociaux. Réseaux, 225(1), La Découverte. 87-120.

Badouard, Romain (2021b). Shadow ban. L’invisibilisation des contenus en ligne. Esprit, 479(1). 75-83.

Beddoe, Kate (2021). Google News Showcase launches in Australia [article de blog]. [En ligne] Google, 4.02.2021.

Benedetti Valentini, Fabio (2021). Droits voisins : l’AFP passe un accord avec Google pour rémunérer ses contenus. [En ligne] Les Echos, 17.11.2021.

Benjamin, Ruha (2019). Race after technology: abolitionist tools for the new Jim Code. Polity Press.

CBSnews (2021). Facebook whistleblower Frances Haugen: the 60 minutes interview. [Vidéo en ligne], YouTube.com, 04.10.2021

Clark, Mike (2021). Research cannot be the justification for compromising people’s privacy [article de blog]. Fb.com, 03.08.2021.

CNBC Television (2018). Google CEO Sundar Pichai testifies before the House judiciary committee. [Vidéo en ligne], YouTube.com, 11.12.2018.

CNCDH (Commission Nationale Consultative des Droits de l’Homme) (2021). Rapport sur la lutte contre le racisme, l’antisémitisme et la xénophobie, l’empreinte antisémite dans l’espace Youtube français (synthèse).

Cohen, Harris (2020). Bringing fact check information to Google Iimages [article de blog]. [En ligne] Google, 22.06.2020.

Conseil Constitutionnel (2020). Décision N° 2020-801 DC du 18.06.2020.

Debouté, Alexandre (2021). Droits voisins : Microsoft s’engage avec la presse européenne. [En ligne] LeFigaro.fr, 23.02.2021.

Décugis, Jean-Michel et Pham-Lê Jérémie (2021). Censure d’Instagram : des féministes assignent Facebook en justice. LeParisien.fr, 9.03.2021.

Digital Markets Act (2020) : Proposition de règlement du Parlement européen et du Conseil relatif aux marchés contestables et équitables dans le secteur numérique (législation sur les marchés numériques), COM/2020/842 final.

Digital Service Act (2020) : Proposition de règlement du Parlement européen et du Conseil relatif à un marché intérieur des services numériques (Législation sur les services numériques) et modifiant la directive 2000/31/CE, COM/2020/825 final.

Directive (UE) 2019/790 du Parlement européen et du Conseil du 17 avril 2019 sur le droit d’auteur et les droits voisins dans le marché unique numérique et modifiant les directives 96/9/CE et 2001/29/CE (Texte présentant de l’intérêt pour l’EEE.), Pub. L. No. 32019L0790, OJ L 130 (2019).

Edelson, Laura, Minh-Kha, Nguyen, Goldstein, Ian, Goga, Oana, Lauinger, Tobias et McCoy, Damon. (2021). Far-right news sources on Facebook more engaging [article du blog Cybersecurity for Democracy]. Medium.com, 03.03.2021.

Edwards, Douglas (2011). I’m feeling lucky: the confessions of Google employee number 59. Houghton Mifflin Harcourt.

Facebook (2007). Facebook unveils Facebook ads. En ligne, fb.com, 06.11.2007.

Faddoul, Marc, Chaslot, Guillaume et Farid, Hany (2020). A longitudinal analysis of YouTube’s promotion of conspiracy videos. [En ligne] arXiv.org, 06.03.2020.

Fogg, B. J. (2009). A behavior model for persuasive design. Proceedings of the Fourth International Conference on Persuasive Technology. 1-7.

Folkenflik, David (adapté de Kate Nocack et Andrew Rossi) (2011). Page one: inside The New York Times and the future of journalism. PublicAffairs.

Girard, Charles (2021). Quel espace public pour Internet ? Esprit, 479(1). 39-49.

Habermas, Jürgen (1962-1988). L’espace public. Archéologie de la publicité comme dimension constitutive de la société bourgeoise. Traduit par Marc B. de Launay. Payot & Rivages.

Hagey, Keach et Jeff Horowitz. Inside Facebook, debates over politics rage. Wall Street Journal, 25.10.2021.

Harris, R. (2021). Google News Showcase is launching in the U.K. [article de blog]. [En ligne] Google, 10.02.2021.

Henni, Jamal (2021). FranceSoir perd son procès contre YouTube et Google. [En ligne] Capital.fr, 11.06.2021.

Herrman, John (2012). Facebook Social Readers are all collapsing. [En ligne] BuzzFeedNews.com, 07.05.2012.

House Judiciary Committee (2020). Investigation of competition in digital markets majority staff report and recommendations.

Isaac, Mike (2011). A first look at Social Reader, WaPo’s new Facebook app. [En ligne] Wired, 22.09.2011.

Kemp, Simon (2021). Digital 2021: Global Overview Report. [En ligne]. Datareportal.com.

Knight First Amendment Institute (2021). Researchers, NYU, Knight Institute condemn Facebook’s effort to squelch independent research about misinformation [communiqué]. [En ligne] KnightColumbia.org, 04.08.2021.

Kosslyn, Justin et Yu, Cong (2017). Fact check now available in Google search and news around the world [article de blog]. [En ligne] Google, 07.04.2017.

Le Monde avec AFP (2021). Facebook va rémunérer une partie de la presse française au titre des « droits voisins ». [En ligne] Le Monde, 21.10.2021.

Lefilliâtre, Jérôme (2019). Fact-checking : à l’AFP, les faits boule de neige. [En ligne] Liberation.fr, 20.05.2019.

Levine, Samuel (2021). Letter from acting director of the Bureau of consumer protection Samuel Levine to Facebook. [En ligne] FTC.gov, 05.08.2021.

Levy, Ro’ee (2021). Social media, news consumption, and polarization: evidence from a field experiment. American Economic Review 111(3), 831-70.

Loi N° 2019-775 du 24 juillet 2019 tendant à créer un droit voisin au profit des agences de presse et des éditeurs de presse.

Loi N° 2020-766 du 24 juin 2020 visant à lutter contre les contenus haineux sur internet.

Mabi, Clément (2021). « La concurrence algorithmique. Logique de mobilisations en ligne ». Esprit, 479(1), p. 65-73.

Ministère de la Culture. [En ligne] Culture.gouv.fr. Aides à la Presse.

Mitchell, Amy, Jurkowitz, Mark, Oliphant, J. Baxter et Shearer, Elisa (2021). Americans who mainly got news via social media knew less about politics and current events, heard more about some unproven stories. How Americans Navigated the News in 2020: A Tumultuous Year in Review, Pew Research Center. 34-40.

Nicas, Jack (2018). How YouTube drives people to the Internet’s darkest corners. [Vidéo en ligne] WSJcom, 07.02.2018.

Pichai, Sundar (2020). Sundar Pichai’s testimony before the Senate Commerce Committee [article de blog]. [En ligne] Google.

Purnell, Newley et Jeff Horowitz (2021). Indian users Of Facebook fanned hate. Wall Street Journal, 25.10.2021.

R. A. (2018). « L’Origine du monde » censuré sur Facebook : pas de préjudice, selon la justice. [En ligne] LeParisien.fr, 16.03.2018.

Rosemain, Mathieu (2021). Exclusive: Google’s $76 million deal with French publishers leaves many outlets infuriated. [En ligne] Reuters, 12.02.2021.

Scheck, Justin, Newley Purnell et Jeff Horowitz avec Neha Wadekar (2021). Facebook’s staff flags criminals, but company often fails to act. Wall Street Journal, CCLXXVIII, 66(1), 17.09.2021.

Schrage, Michael (2020). Recommendation engines. MIT Press.

Sharon, Tamar (2021). From hostile worlds to multiple spheres: towards a normative pragmatics of justice for the Googlization of health. Medicine, Health Care and Philosophie, 24(1). 315-327.

SimilarWeb (2021a). Analyse de Lemonde.fr – Statistiques sur la part de marché et le classement en fonction du trafic. [En ligne] Similarweb.com, 06.2021.

SimilarWeb (2021b). Analyse de Nytimes.com – Statistiques sur la part de marché et le classement en fonction du trafic. [En ligne] Similarweb.com, 06.2021.

Turing, Alan M. (1937). On computable numbers, with an application to the entscheidungsproblem. Proceedings of the London Mathematical Society, 42(1). 230-265.

Turing, Alan M. (1938). On computable numbers, with an application to the entscheidungsproblem. A correction. Proceedings of the London Mathematical Society, 43(1). 544-546.

UEJF (Union des étudiants juifs de France), SOS Racisme, et SOS Homophobie. La Haine en ligne se propage pendant le confinement. [En ligne] UEJF.org, 06.05.2020.

Vauchez, Ysé (2019). Les mythes professionnels des fact-checkeurs. Un journalisme de données au service de la vérité. Politiques de communication, 12(1). 21-44.

Walzer, Michael (1983-2013). Sphères de Justice, trad. Pascal Engel. Seuil.

Walzer, Michael (1985). Interpretation and social criticism, the Tanner lectures on human values. Cambridge : Harvard University, disponible en français sous le titre de Critique et sens commun, trad. Joël Roman. La Découverte, 1990.

Weid, Guillaume von der (2017). Quelle justice sur les réseaux sociaux ? Les Cahiers de la Justice, 3(1). 521-529.

Zuboff, Shoshana (2019). Un capitalisme de surveillance. [En ligne] Monde-diplomatique.fr, 01.2019.

Référence de publication (ISO 690) : DEMICHELIS, Rémy. Médias et sphères de justice : réduire la prédominance des plateformes Internet de recommandation. Les Cahiers du journalisme - Recherches, 2021, vol. 2, n°7, p. R67-R89.

DOI:10.31188/CaJsm.2(7).2021.R067